ChatGPT está conquistando el mundo digital. Gracias a su capacidad de comprender nuestro lenguaje y de generar texto con calidad casi humana.

El potencial de ChatGPT es inmenso. Es un servicio de chat impulsado por la Inteligencia Artificial Generativa que gana más fuerza cada día y que debe ser parte de las estrategias organizacionales. Por lo que es importante comprenderlo ampliamente.

En este post nos centraremos en entender qué es lo que hace tan especial al modelo de lenguaje ChatGPT, su origen, su entrenamiento y la clave de su alta comprensión y precisión: la arquitectura Transformer.

Tabla de Contenidos

ChatGPT de OpenAI

ChatGPT ha sido creado por OpenAI, una organización fundada en el 2015 con fines de investigación, que se centra en el desarrollo de la inteligencia artificial en beneficio de la humanidad.

OpenAI reune a grandes personalidades de la industria tecnológica; en su dirección, en el área de investigación y como financiadores, entre las que se incluyen Greg Brockman, Sam Altman, Jessica Livingston, Peter Thiel, Ilya Sutskever y el muy mediático Elon Musk. Además, Bill Gates (Microsoft) es uno de los mayores inversores de OpenAI.

¿Qué es ChatGPT?

ChatGPT es un poderoso chatbot impulsado por la Inteligencia Artificial Generativa y desarrollado sobre el modelo de lenguaje GPT-3 (programa informático que genera textos para responder las instrucciones o preguntas recibidas en lenguaje natural).

Exactamente, ¿qué hizo OpenAI? Tomó el modelo de lenguaje GPT-3 y lo llevó al siguiente nivel, lo hizo más útil, más seguro y más “inteligente”, a través de métodos de aprendizaje automático de la IA y la incorporación de más tecnología.

ChatGPT es un gran modelo de lenguaje (large language model LLM) que ha sido entrenado cuidadosamente con una enorme cantidad de información para que sea capaz de generar respuestas con calidad casi humana ante cualquier pregunta o indicación que le realice el usuario.

ChatGPT tiene la capacidad de interactuar con las personas mediante un formato de diálogos, de manera conversacional. Responde preguntas de manera original, puede cuestionar premisas incorrectas y rehacer solicitudes inapropiadas. Incluso, puede admitir sus propios errores.

¿Qué significa ChatGPT?

Las siglas ChatGPT significan Generative Pre-Trained Transformer GPT (Transformer Pre-entrenado Generativo). ¿Por qué?

- Generative, porque es un modelo que puede crear contenido completamente nuevo y original.

- Transformer, porque cuenta con una arquitectura avanzada que le permite fijar la atención en lo más importante de la información, comprender el contexto y aprender más rápido.

- Pre-Trained, porque ha sido sometido a etapas de aprendizaje para que aprenda los patrones que le permiten comprender el lenguaje humano y responder con una altísima precisión.

Pero pasemos a comprender cada detalle técnico de este chat que está revolucionando el mundo.

¿Qué es un modelo?

Básicamente, un modelo es un programa computacional o un algoritmo (instrucciones secuenciales de pasos para ejecutar cierta tarea) diseñado para simular algún comportamiento o sistema del mundo real.

Por ejemplo, están los modelos meteorológicos que son alimentados con datos históricos del clima para poder comprender los fenómenos climáticos y predecirlos.

En el campo del aprendizaje automático, o Machine Learning ML, los modelos son muy parecidos a este ejemplo. Aunque, el modelo con el que opera ChatGPT supera todas las expectativas.

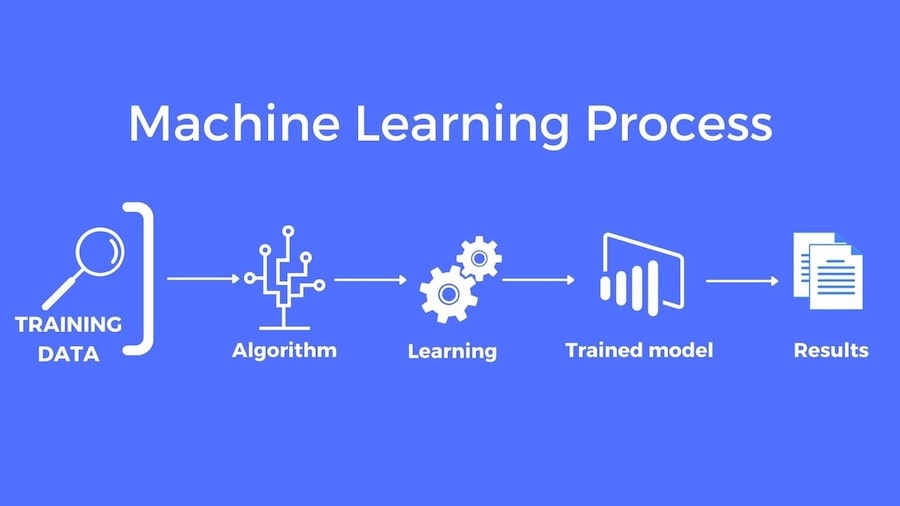

¿Cómo son los modelos de aprendizaje automático?

Los modelos o algoritmos de aprendizaje automático son alimentados con datos pasados para que aprendan a representar (fase de entrenamiento), con la mayor fidelidad posible, un comportamiento en cierto campo.

Así se crean los modelos de lenguaje, modelos de aprendizaje automático que se entrenan mediante la entrada y análisis de una gran cantidad de datos, para representar y simular cómo procesan el lenguaje las personas.

En los modelos de lenguaje el usuario ingresa cierta consulta a un ordenador en lenguaje natural (es el lenguaje y la manera de hablar utilizado ordinariamente para la comunicación entre las personas) y obtiene un resultado.

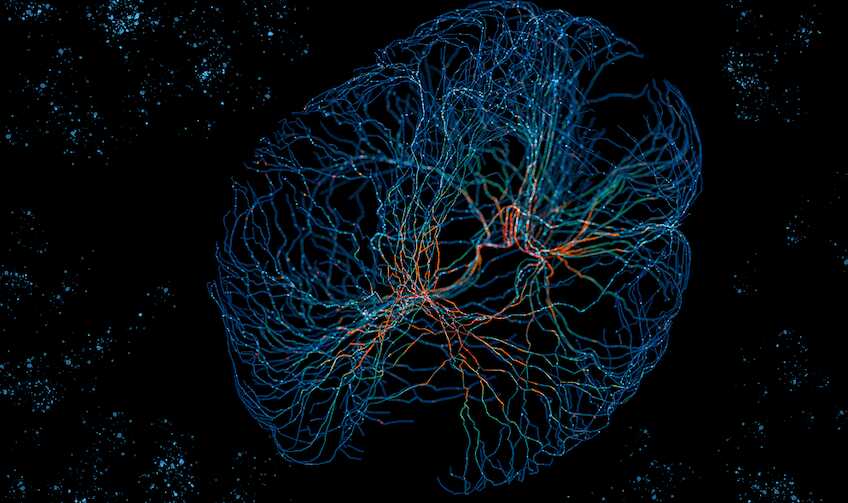

Estos modelos pueden tener diversas complejidades, desde simples modelos probabilísticos, que pueden predecir la siguiente palabra dentro de una secuencia, hasta sofisticadas redes neuronales artificiales, que son modelos que simulan la manera en la que el cerebro humano logra procesar la información.

De manera general, una red neuronal artificial está basada en una serie de pequeños nodos o neuronas conectadas (pequeñas funciones matemáticas), normalmente organizadas en capas, que calculan una salida según el dato de entrada dado. Esto permite modelar las relaciones entre frases y palabras. Una red neuronal puede ser muy pequeña (pocas neuronas) o muy grande, como los modelos LLM.

Por ejemplo, son modelos de redes neuronales los algoritmos de traducción automática, como los de Google Translate.

Pero el modelo de ChatGPT aún va más allá.

El gran modelo de lenguaje LLM de ChatGPT y la arquitectura Transformer

ChatGPT es un gran modelo de lenguaje LLM que utiliza una particular estructura de redes neuronales artificiales llamada Transformer, en la que se amplía de manera drástica la cantidad de datos empleados para su entrenamiento (fase de aprendizaje).

ChatGPT es uno de los LLM más potentes que se han desarrollado. Las clave de esta potencia reside en:

- Su estructura Transformers.

- El gran volumen de datos con el que fue entrenado.

- Los diversos métodos de aprendizaje utilizados para su entrenamiento.

Los Transformers: el motor de ChatGPT

Fuente imagen: https://lena-voita.github.io/nlp_course/seq2seq_and_attention.html

La arquitectura Transformer está formada por un sofisticado modelo de redes neuronales artificiales, basada en el “mecanismo de atención” y con la capacidad de procesar al mismo tiempo toda la información de entrada.

La arquitectura Transformer es la que le otorga a ChatGPT la capacidad de realizar algunos trucos en el procesamiento del lenguaje: leer grandes cantidades de texto para comprender y detectar los patrones en las relaciones entre frases y palabras y, después, realizar predicciones sobre qué palabra debe aparecer a continuación de la otra.

- La arquitectura Transformer se basa en el concepto de “mecanismo de atención”, por lo que hace que las redes neuronales puedan centrar su atención en ciertos puntos de la información e ignorar lo demás, tal como lo hacemos los seres humanos. Esto es lo que hace posible que ChatGPT analice masivas cantidades de texto, preste atención sólo a detalles importantes y extraiga el contexto de la información.

Realmente, ChatGPT no posee ningún conocimiento, pero sí que es muy bueno descubriendo qué palabra le sigue a la otra y cuál simula mejor el lenguaje de los humanos. Todo este sistema avanzado de procesamiento del lenguaje y predicción lo lleva a arrojar un resultado completamente original y con una calidad notablemente alta.

Entrenamiento de ChatGPT

ChatGPT es una versión mejorada de GPT-3, mediante el ajuste fino (entrenar un modelo previamente entrenado).

GPT-3 cuenta con 175.000 millones de parámetros. Para esto, fue entrenado con 570 GB de datos obtenidos del repositorio abierto de Common Crawl (con contenido de internet extraído de textos, como blogs y páginas web entre 2016 y 2019), WebText2, bibliotecas y Wikipedia. Esto se trató de un aprendizaje sin supervisión, es decir sin intervención del humano para decir qué información era correcta o que no.

Pero OpenAI mejoró esta versión de GPT-3 y lo convirtió en ChatGPT, mediante:

- El aprendizaje supervisado. OpenAI contrató miles de profesionales para entrenar el modelo de lenguaje GPT-3. Este aprendizaje supervisado es un proceso en el que se lleva a cabo el etiquetado de datos para indicar al modelo qué es correcto o incorrecto, de esta forma el algoritmo se va ajustando hasta que el error sea mínimo. Es una técnica de aprendizaje que hace que ChatGPT genere respuestas de alta calidad.

- El aprendizaje por refuerzo profundo (reinforcement learning from human feedback RLHF). Es otra técnica de aprendizaje automático con la que ChatGPT aprendió en un entorno interactivo con los evaluadores humanos a través de un proceso de retroalimentación de sus propias acciones. ChatGPT generaba varias posibles respuestas a una pregunta y el evaluador se encargaba de calificar, de mejor a peor, cada una de las respuestas del modelo. De esta forma ChatGPT aprendió qué salida resultaba más satisfactoria para los usuarios.

Otros artículos que te pueden interesar:

Los Grandes Modelos de Lenguaje: un mundo más allá de las palabras 3 modelos de redes neuronales que necesitas conocer para entender la IA Generativa Procesamiento del Lenguaje Natural: La clave de la comunicación entre humanos y máquinas La magia de la Inteligencia Artificial Generativa: cómo transformar tus ideas en realidad La historia de OpenAI El secreto de ChatGPT: ¿cómo funciona? ¿Por qué entiende el lenguaje natural?

1 comentario en «ChatGPT: un potente modelo de lenguaje»